INTELLIGENCE ARTIFICIELLE

Intelligence artificielle : un droit en construction

L’essor de l’intelligence artificielle bouleverse les modèles économiques, les relations sociales et l’exercice des droits fondamentaux. Pour répondre aux risques systémiques et garantir un usage responsable de ces technologies, un véritable droit de l’intelligence artificielle se construit, à l’interface du droit du numérique, des libertés publiques et de la régulation économique.

Ce nouveau cadre, structuré autour du règlement européen IA Act, impose aux concepteurs, déployeurs et utilisateurs d’IA des obligations strictes en matière de transparence, de sécurité, de non-discrimination et de gouvernance.

Une expertise pluridisciplinaire construite sur la durée

L’intelligence artificielle ne constitue pas un domaine juridique isolé mais irrigue l’ensemble des branches du droit. Son impact transversal nécessite une approche pluridisciplinaire mobilisant tour à tour le droit des contrats, de la responsabilité civile, de la propriété intellectuelle, des données personnelles, du droit pénal, du droit du travail, et d’autres règles juridiques sectorielles.

Notre expertise s’est construite progressivement depuis l’émergence des premiers enjeux juridiques de l’IA, nous permettant de développer une vision d’ensemble des interactions entre ces différentes branches du droit. Cette approche globale est le fruit de plusieurs années de pratique, de recherches et de réflexion.

Droit européen de l'intelligence artificielle

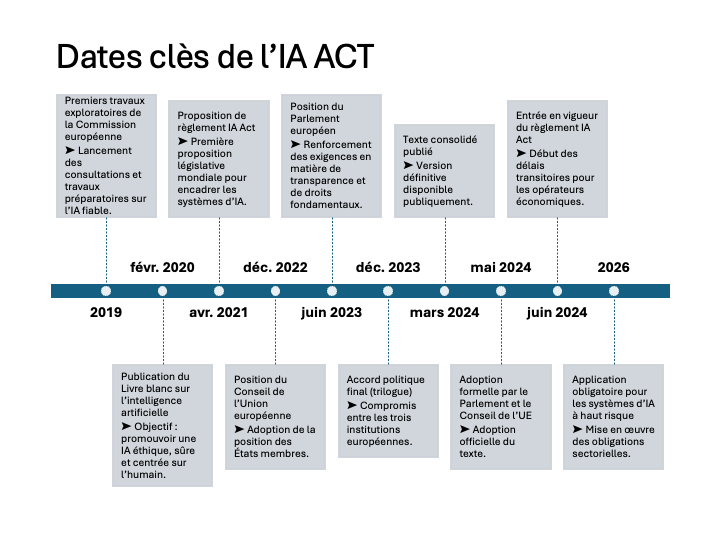

Notre expertise du Règlement européen sur l’intelligence artificielle (AI Act) s’est développée dès les premiers projets de la Commission européenne en 2019. Cet intérêt précoce nous a permis de suivre l’évolution du texte depuis sa genèse, d’anticiper ses implications pratiques et de développer une compréhension fine de ses articulations avec l’ensemble du corpus juridique européen.

Cette expertise historique du processus législatif européen nous permet aujourd’hui de maîtriser non seulement la lettre du Règlement (UE) 2024/1689 mais aussi son esprit et ses objectifs sous-jacents. Nous appréhendons ses interactions complexes avec le RGPD, le Digital Services Act, le Digital Market Act et les réglementations sectorielles dans une vision systémique du droit du numérique.

Approche 360° des enjeux juridiques de l’IA

- Articulation avec le droit de la concurrence (concentrations dans le secteur de l’IA)

- Interactions avec le droit social (systèmes d’IA dans les relations de travail)

- Liens avec le droit de la consommation (protection des consommateurs face aux algorithmes)

- Intrication avec les règles sectorielles (santé, Ressources Humaines, finance, transport)

- Intégration dans le droit administratif (utilisation de l’IA par les administrations publiques)

Propriété intellectuelle et innovations en IA

Protéger les innovations

en matière d’IA

L’innovation algorithmique, les modèles d’apprentissage, les jeux de données d’entraînement, les logiciels embarqués et les interfaces génératives interrogent tous les domaines de la propriété intellectuelle :

- Droit des brevets : brevetabilité des inventions mises en œuvre par IA ou intégrant des algorithmes spécifiques.

- Droit d’auteur et logiciels : protection des codes sources, interfaces, et documentations techniques ; encadrement des cessions et licences.

- Protection des bases de données : qualification juridique des ensembles de données d’entraînement ; prévention du risque d’extraction illicite ou de réutilisation non autorisée.

- Secrets d’affaires et contrats : sécurisation contractuelle des informations stratégiques (architecture des modèles, choix de données, configur

Vers une reconnaissance juridique

de l’IA comme inventeur ?

Le développement des IA génératives soulève une question fondamentale : qui est titulaire des droits sur une invention ou une création générée de manière autonome par une machine ?

Si les offices de brevets (INPI, OEB, USPTO) rejettent à ce jour la reconnaissance d’une IA comme inventeur, le débat juridique est ouvert.

Nous assurons une veille active sur ces évolutions et vous conseillons sur :

- Les stratégies de titularité dans les projets exploitant des IA génératives ;

- L’encadrement contractuel de la contribution humaine dans les créations assistées ;

- La gestion des risques juridiques liés à l’absence de paternité humaine identifiable.

Encadrer l’usage des œuvres et données

dans l’entraînement des IA

L’entraînement des IA sur des corpus existants soulève de nombreux enjeux juridiques :

- Respect des droits d’auteur : encadrement de l’utilisation d’œuvres protégées (textes, images, musiques) à des fins d’entraînement, en lien avec les exceptions de fouille de textes et de données (text & data mining).

- Licences et conditions d’usage : vérification de la compatibilité des licences (Creative Commons, open data, etc.) avec les finalités du traitement.

- Protection des bases de données : risque d’extraction illicite ou de parasitisme lors de l’absorption de données structurées.

- Encadrement contractuel : audit des sources de données, conformité avec le RGPD, anticipation des responsabilités en cas d’exploitation illicite des contenus.

Gérer les droits dans

les projets IA collaboratifs

Les projets d’IA impliquent souvent plusieurs partenaires (développeurs, chercheurs, clients, fournisseurs de données).

Nous vous accompagnons pour structurer :

Les conventions de R&D et de co-développement ;

La répartition des droits de propriété intellectuelle ;

La gouvernance des contributions techniques et des jeux de données ;

Les modalités de valorisation et de diffusion des résultats.

Protection des données et IA

Données personnelles & IA

L’intelligence artificielle repose largement sur l’exploitation de données, parmi lesquelles les données personnelles occupent une place centrale. Leur protection constitue donc un enjeu juridique fondamental pour encadrer les systèmes d’IA, garantir les droits des personnes et instaurer une confiance numérique durable.

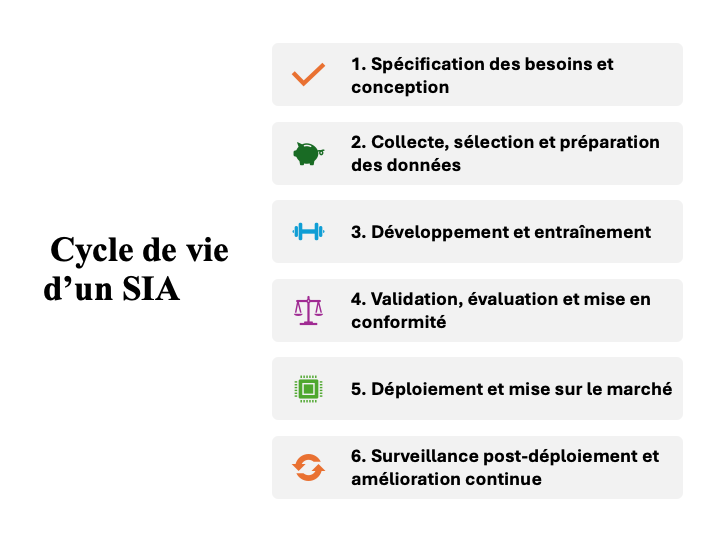

FG Avocat mobilise une double expertise en droit de la protection des données personnelles (RGPD, loi Informatique et Libertés) et en régulation de l’intelligence artificielle (IA Act, doctrine européenne et avis des autorités). Nous accompagnons les acteurs publics et privés à chaque étape du cycle de vie de leurs systèmes d’IA : conception, développement, mise en production et évolution des modèles.

Problématiques juridiques clés

- Qualification du traitement : détermination du rôle exact du responsable de traitement dans les chaînes de traitement IA complexes (entraîneurs, fournisseurs de modèles, intégrateurs, utilisateurs).

- Base légale et finalité : compatibilité des traitements IA avec les bases juridiques du RGPD (intérêt légitime, consentement, obligation légale, etc.).

- Transparence algorithmique : information accessible sur le fonctionnement des modèles, notamment en cas de prise de décision automatisée (article 22 RGPD).

- Privacy by design & AIPD : intégration des principes de protection dès la conception, réalisation d’analyses d’impact sur la vie privée (AIPD) pour les traitements à haut risque.

IA et contrats

Encadrer juridiquement le cycle de vie des SIA

Le contrat au cœur du cycle de vie des systèmes d’IA

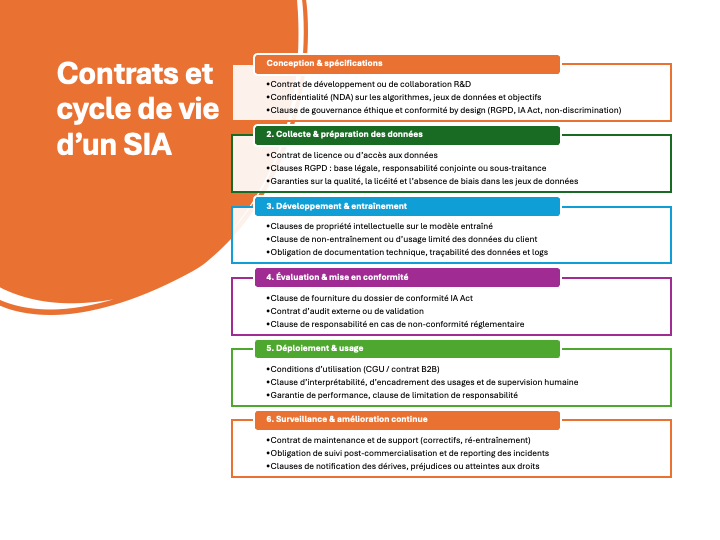

Les systèmes d’intelligence artificielle (SIA) soulèvent des enjeux contractuels à chaque étape de leur développement, déploiement et usage. Le contrat est un outil fondamental pour sécuriser juridiquement les responsabilités des parties, garantir la conformité aux normes applicables et anticiper les risques.

Les obligations contractuelles doivent être pensées tout au long du cycle de vie du SIA, selon les étapes suivantes :

Responsabilité des acteurs IA

Les enjeux de la responsabilité du fait de l'IA

Le développement de l’intelligence artificielle soulève des défis inédits en matière de responsabilité civile et pénale. Les systèmes d’IA, notamment lorsqu’ils sont autonomes ou auto-apprenants, peuvent produire des effets dommageables sans qu’un lien de causalité direct et identifiable avec une action humaine soit évident.

Les principaux enjeux juridiques :

- Identification du responsable : concepteur, fournisseur, utilisateur, intégrateur ?

- Charge de la preuve : comment prouver une faute, un défaut ou un lien de causalité en cas de dommage ?

- Responsabilité sans faute : faut-il instaurer une présomption de responsabilité ?

- Réparation intégrale : garantir l’accès effectif des victimes à l’indemnisation.

- Prévisibilité du droit : fournir un cadre clair et sécurisé pour les opérateurs économiques

Cadre juridique en vigueur

➤ Droit commun de la responsabilité civile (Code civil)

- Responsabilité pour faute (articles 1240 et 1241 C. civ.) : nécessite de démontrer une faute, un préjudice et un lien de causalité.

- Responsabilité du fait des choses (article 1242 al. 1 C. civ.) : applicable aux dommages causés par un système d’IA assimilé à une chose sous la garde d’un responsable.

➤ Responsabilité civile contractuelle

Les contrats de fourniture ou d’intégration d’IA peuvent contenir des clauses de responsabilité, de garantie ou d’exonération. Le devoir de conseil, la qualité des données utilisées, la maintenance et l’explicabilité sont des points critiques.

➤ Responsabilité pénale

- Responsabilité pénale des personnes physiques : une personne physique peut être tenu pénalement responsable pour les infractions commises via l’IA, s’il y a participation, négligence ou intentionnalité avérée.

- Responsabilité pénale des personnes morales (articles 121-2 et s. Code pénal) : l’entreprise peut être poursuivie si l’infraction est commise pour son compte, par un organe ou un représentant. La vigilance sur la gouvernance, les processus de validation, et les audits des systèmes d’IA devient essentielle

2. Initiatives de l’Union européenn

➤ Règlement (UE) 2024/1689-IA Act

- Établit un cadre de conformité ex ante pour les systèmes d’IA à haut risque.

- Prévoit des obligations en matière de qualité des données, d’audit, de documentation, de surveillance humaine et de gestion des incidents.

➤ Abandon de la directive sur la responsabilité extracontractuelle de l’IA

- La Commission européenne a renoncé à proposer un régime harmonisé autonome de responsabilité extracontractuelle spécifique à l’IA.

- Modification de la directive de 85 sur la responsabilité du fait des produits défectueux (directive 85/374/CEE modifiée par la directive (UE) 2024/…): cette directive s’applique également aux systèmes d’IA considérés comme produits ; le fabricant peut être tenu responsable en cas de défaut de sécurité, même sans faute

➤ Enjeux pour les victimes et accès au droit

- Renforcement des mécanismes de preuve : journalisation des décisions algorithmiques, traçabilité des données.

- Action de groupe ou recours stratégiques possibles en cas de dommages collectifs.

- Rôle du Défenseur des droits, de la CNIL, et du juge judiciaire pour garantir l’effectivité des droits fondamentaux.