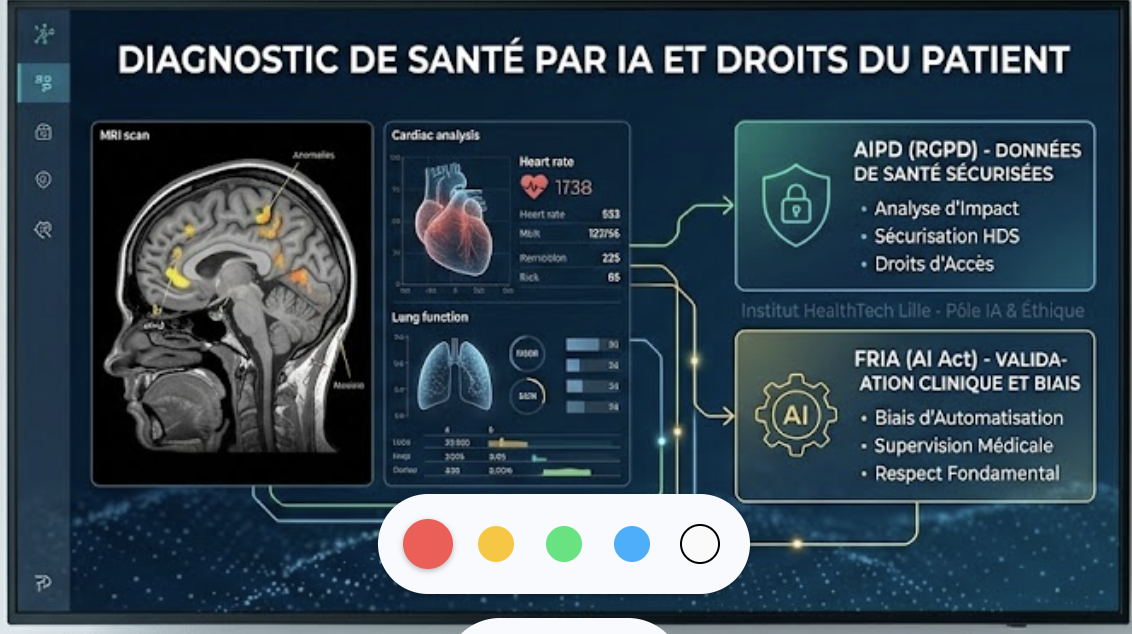

Le déploiement d’une intelligence artificielle, qu’il s’agisse d’un chatbot patient, d’un outil de diagnostic assisté ou d’un système de gestion hospitalière, impose des obligations juridiques strictes. Avant toute mise en production, deux évaluations majeures s’imposent : l’AIPD (RGPD) et la FRIA (AI Act).

1. L’AIPD : pourquoi l’IA déclenche-t-elle l’obligation ?

L’AIPD est une évaluation préalable des risques pour les droits et libertés, obligatoire selon l’article 35 du RGPD dès que le traitement est « susceptible d’engendrer un risque élevé ».

En matière d’IA, ce seuil est presque systématiquement atteint car ces projets activent souvent plusieurs critères du CEPD :

- Profilage et décision automatisée : aide au diagnostic, prédiction de rechute.

- Données sensibles à grande échelle : données de santé, biométrie.

- Usage innovant : IA générative, deep learning.

Le conseil du cabinet : pour l’IA, l’AIPD n’est pas une option, c’est le socle de votre démonstration de conformité (Accountability).

2. Focus santé : un niveau d’exigence maximal

Le secteur de la santé est le terrain où les contraintes juridiques convergent avec le plus d’intensité.

Pourquoi l’AIPD est-elle critique en santé ?

Tout projet d’IA en santé traite par définition des données sensibles (Article 9 du RGPD). Si ce traitement est réalisé à grande échelle (établissement de santé, plateforme nationale), l’AIPD est une obligation légale absolue.

Points de vigilance spécifiques :

- Hébergement HDS : l’AIPD doit intégrer les garanties offertes par l’Hébergeur de Données de Santé.

- Référentiels CNIL : la conformité aux méthodologies de référence (ex: MR-001, MR-003) doit être documentée.

- Droit à l’explication : le patient doit pouvoir comprendre pourquoi l’IA a suggéré une orientation thérapeutique.

L’IA en santé est-elle classée à « haut risque » au titre de l’AI Act ?

Oui, dans la majorité des cas. Les systèmes d’IA utilisés comme composants de sécurité pour des dispositifs médicaux sont classés à « haut risque » (Annexe III). Cela implique la réalisation d’une FRIA (Fundamental Rights Impact Assessment).

3. La « garantie humaine » : le pilier de l’IA médicale

L’article 14 de l’AI Act et la Loi Bioéthique imposent une supervision humaine effective. Il ne s’agit pas d’une simple validation formelle, mais d’un contrôle actif du praticien.

Lutter contre le « biais d’automatisation »

Le principal risque identifié par les autorités de santé est que le professionnel suive aveuglément la suggestion de l’IA par excès de confiance. La supervision doit permettre au médecin de :

- Comprendre les limites du modèle (ex: cas où l’IA est moins performante).

- Ignorer ou contester une recommandation de l’IA sans crainte de conséquences administratives.

- Intervenir à tout moment pour reprendre la main sur le système.

Mise en œuvre pratique dans vos projets

Dans vos AIPD et FRIA, vous devez documenter :

- L’interface utilisateur : comment l’indice de confiance du modèle est-il affiché au médecin ?

- La formation : comment les soignants sont-ils formés à critiquer l’algorithme ?

- L’alerte : existe-t-il un « bouton d’arrêt d’urgence » ou une procédure de débrayage ?

4. AIPD vs FRIA : quelles différences ?

| Caractéristique | AIPD (RGPD) | FRIA (AI Act) |

|---|---|---|

| Focus | Protection des données personnelles. | Tous les droits fondamentaux (dignité, non-discrimination). |

| Question clé | Que risquent les personnes dont je traite les données ? | Ce système porte-t-il atteinte à la sécurité ou aux droits des patients ? |

| Entrée en vigueur | Déjà applicable. | 2 août 2026. |

5. Checklist : votre projet est-il prêt pour l’AI Act ?

- [ ] Qualification : avez-vous déterminé si votre IA est un Dispositif Médical (DM) ou un composant de sécurité ?

- [ ] Gouvernance des données : vos jeux de données d’entraînement et de test sont-ils exempts de biais discriminatoires (âge, origine, sexe) ?

- [ ] Documentation technique : votre système de gestion des risques est-il documenté conformément à l’article 9 de l’AI Act ?

- [ ] Supervision : le protocole de « garantie humaine » est-il intégré à l’interface (UX) et validé par un comité éthique ?

- [ ] Transparence : la notice d’utilisation explique-t-elle clairement le fonctionnement de l’algorithme aux soignants et aux patients ?

6. Sanctions : un risque financier et opérationnel

Un défaut de conformité peut entraîner :

- Amendes RGPD : Jusqu’à 20 M€ ou 4 % du CA mondial.

- Amendes AI Act : Jusqu’à 15 M€ ou 3 % du CA mondial.

- Blocage CNIL : Consultation préalable obligatoire de 14 semaines en cas de risque résiduel élevé.

Besoin d’un accompagnement expert ?

Le secteur de la santé ne tolère aucune approximation juridique. Notre cabinet vous aide à réaliser vos AIPD Santé, à préparer vos FRIA et à organiser la supervision humaine de vos systèmes.

Références clés :

- RGPD, Articles 9 et 35.

- AI Act, Article 14 (Supervision humaine) et Article 27 (FRIA).

- Code de la Santé Publique (Garantie humaine).